O ChatGpt enfrenta queixa legal depois que um usuário inseriu seu próprio nome e descobriu que os acusou de crimes inventados

Ai ‘alucinações’ são um fenômeno bem documentado. Como os grandes modelos de idiomas estão apenas dando seu melhor palpite sobre qual palavra provavelmente virá a seguir e não entende coisas como o contexto, elas são propensas a simplesmente inventar as coisas. Entre fatos falsos de queijo e conselhos médicos que giram estômago, a desinformação como essa pode ser engraçada, mas está longe de ser inofensiva. Agora, pode realmente haver um recurso legal.

Um homem norueguês chamado Arve Hjalmar Holmen recentemente iniciou uma conversa com o ChatGPT para ver quais informações o Chatbot do Openai ofereceria quando ele digitou em seu próprio nome. Ele ficou horrorizado quando Chatgpt supostamente girou um fio falsamente reivindicando Ele matou seus próprios filhos e foi condenado a 21 anos de prisão (via TechCrunch). O aspecto mais assustador? Em torno da história do crime inventado, o Chatgpt incluiu alguns detalhes precisos e identificáveis sobre a vida pessoal de Holman, como o número e o gênero de seus filhos, bem como o nome de sua cidade natal.

O Grupo de Advocacia de Direitos de Privacidade Noyb logo se envolveu. A organização disse ao TechCrunch que realizou sua própria investigação sobre por que o ChatGPT poderia estar emitindo essas reivindicações, verificando se talvez alguém com um nome semelhante tenha cometido crimes graves. Por fim, eles não conseguiram encontrar nada substancial nesse sentido, então o ‘porquê’ por trás da produção de arrepiar o cabelo do Chatgpt permanece incerta.

O modelo de IA subjacente do chatbot foi atualizado e agora não repete mais as reivindicações difamatórias. No entanto, Noyb, tendo apresentado reclamações anteriormente Chatgpt em produzir informações imprecisas sobre figuras públicasnão ficou satisfeito em fechar o livro aqui. A organização agora apresentou uma queixa à DatatilSynet (a Autoridade de Proteção de Dados Norueguês), com o argumento de que o ChatGPT violou o GDPR.

Sob Artigo 5 (1) (d) Do direito da UE, as empresas que processam os dados pessoais precisam garantir que sejam precisos – e se não forem precisos, devem ser corrigidos ou excluídos. Noyb defende que, apenas porque o ChatGPT parou de acusar falsamente Holmen de ser um assassino, isso não significa que os dados foram excluídos.

Noyb escreveu: “Os dados incorretos ainda podem permanecer parte do conjunto de dados do LLM. Por padrão, O ChatGPT alimenta os dados do usuário de volta ao sistema Para fins de treinamento. Isso significa que não há como o indivíduo ter certeza absoluta de que essa saída pode ser completamente apagada (…), a menos que todo o modelo de IA seja treinado. ”

Noyb também alega que, por sua natureza, o chatgpt não cumpre Artigo 15 do GDPR. Simplificando, não há garantia de que você possa ligar de volta o que você alimentar para ChatGPT – ou ver os dados sobre você foi alimentado em seu conjunto de dados. Nesse ponto, o NOYB compartilha: “Esse fato, compreensivelmente, ainda causa angústia e medo pelo queixoso (Holmen)”.

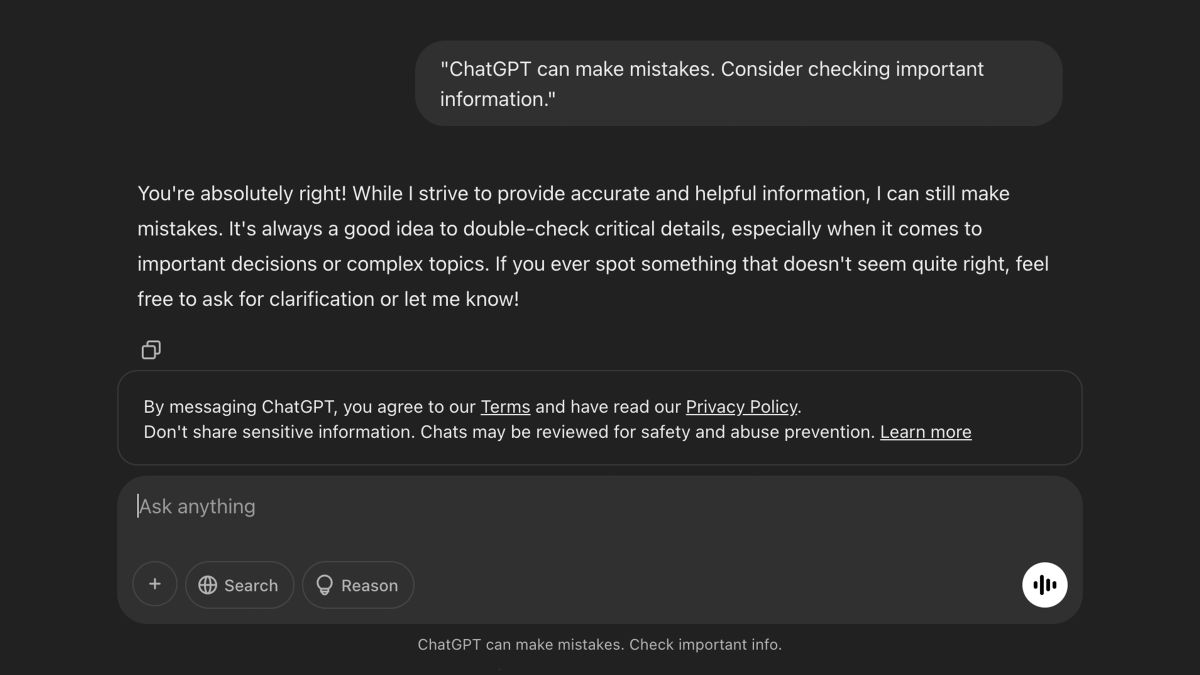

Atualmente, o NOYB está solicitando que a ordem do DatAtilSynet OpenAI o OpenAI para excluir os dados imprecisos sobre Holmen, e que a empresa garante que o ChatGPT não possa alucinar outra história de terror sobre outra pessoa. Dada a abordagem atual do OpenAI, está apenas exibindo o aviso “Chatgpt pode cometer erros. Considere verificar informações importantes”, em uma pequena fonte na parte inferior de cada sessão do usuário, essa é uma tarefa difícil.

Ainda assim, fico feliz em ver que o Noyb aplicará pressão legal ao OpenAI, especialmente porque o governo dos EUA aparentemente jogou cautela ao vento e entrou na IA com o plano de infraestrutura ‘Stargate’. Quando o ChatGPT pode facilmente gerar reivindicações difamatórias ao lado de informações precisas, identificando informações, uma migalha de cautela parece menos do que o mínimo.