O artigo co-autor da Microsoft sugere que o uso regular de Gen-AI pode deixar os usuários com uma ‘habilidade diminuída para solução de problemas independentes’ e pelo menos um modelo de IA parece concordar

Se você acha que os trabalhadores dependem fortemente da IA generativa pode estar menos preparada para enfrentar perguntas que não podem ser respondidas sucintamente pela máquina, você pode estar certo.

UM artigo recente Dos pesquisadores da Microsoft e da Carnegie, tentaram estudar os efeitos da IA generativa no “esforço cognitivo” dos trabalhadores em um recente estudo auto-relatado. Nele, o artigo diz: “Usado de forma inadequada, as tecnologias podem e resulta na deterioração das faculdades cognitivas que deveriam ser preservadas”

De 319 trabalhadores totais que usam ferramentas generativas de IA como ChatGPT ou Copilot para o trabalho pelo menos uma vez por semana, estudando 936 aplicáveis ”Exemplos de uso de ferramentas genai do mundo real”, os participantes compartilham como executam seu trabalho. O estudo verificou que o pensamento crítico foi implantado principalmente para verificar a qualidade do trabalho e, à medida que a confiança nas ferramentas da IA aumentava, os esforços de pensamento crítico diminuíram ao lado dele.

O artigo conclui:

“Para esse fim, nosso trabalho sugere que as ferramentas da Genai precisam ser projetadas para apoiar o pensamento crítico dos trabalhadores do conhecimento, abordando suas barreiras de consciência, motivação e habilidade”.

Como o artigo é baseado em auto-relatos dos 319 trabalhadores, este estudo é impulsionado pela autopercepção de trabalho. Como tal, algumas barreiras se apresentaram na metodologia. Por exemplo, o artigo relata que alguns participantes confundiriam a complexidade e a consistência do trabalho com habilidades menos críticas.

Efetivamente, se a resposta gerada pela IA foi satisfatória para o usuário que a gerou, isso levou a uma autopercepção de que eles não foram tão críticos quanto aquele que parece mais complexo para eles. Além disso, méritos como pensamento crítico e satisfação são de natureza subjetiva.

“Em trabalhos futuros, estudos longitudinais rastreando mudanças nos padrões de uso de IA e seu impacto nos processos de pensamento crítico seriam benéficos”.

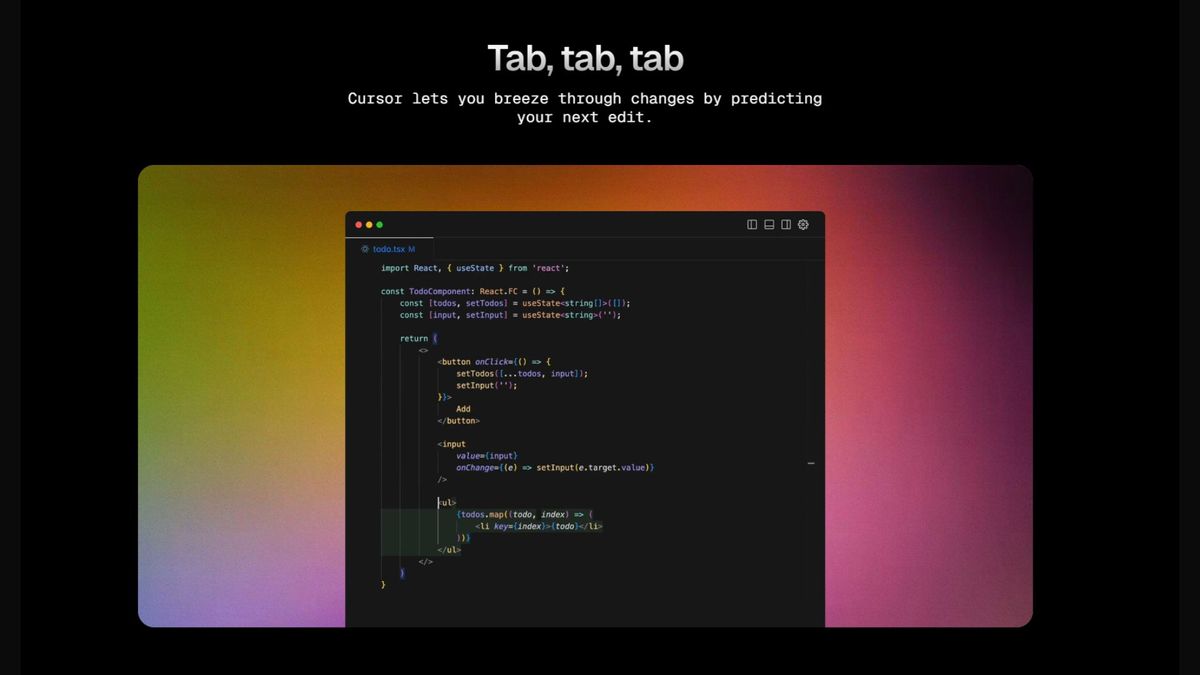

No entanto, a conclusão de que mais fé nas ferramentas generativas da IA pode levar a um pensamento menos crítico em torno de seus resultados é algo imitado em uma ferramenta de IA do mundo real. Cursor, um editor de código baseado em IA recentemente respondeu a um pedido de mais de 750 linhas de código, afirmando que não poderia gerar esse valor para o usuário, pois estaria “completando seu trabalho” (via ARS Technica). Ainda explica:

“A geração de código para outros pode levar a dependência e oportunidades reduzidas de aprendizado”

O usuário relatando esse ‘problema’ responde ao pronta para dizer “, não tenho certeza se os LLMs sabem para que são (lol)”. O usuário original respondeu a um comentário informando que seu prompt original para o cursor foi “apenas continue gerando código; portanto, continue então, continue até que você atinja as tags de fechamento, continue gerando código”.

No entanto, a ‘lógica’ por trás da resposta de Cursor faz sentido à luz deste artigo recente. Se um codificador estiver pedindo à IA que desenvolva centenas de linhas de código, e os problemas persistem com o referido código, seria muito mais difícil encontrar o problema quando você não souber o que está lá em primeiro lugar.

Fundamentalmente, as ferramentas geradas pela IA são falíveis. Eles são criados através de dados de raspagem (alguns dos quais com direitos autorais) e são propensos a alucinações graças à multidão de informações. Eles podem, e muitas vezes estarão errados, e é importante criticar as informações que você recebe ao usá -las.

Como este estudo sugere, se implementado em um fluxo de trabalho, as ferramentas de IA precisam ser examinadas consistentemente para evitar perder as habilidades de pensamento crítico necessárias para lidar com faixas tão amplas de dados.

Como o artigo relata, “as ferramentas da Genai estão em constante evolução e as maneiras pelas quais os trabalhadores do conhecimento interagem com essas tecnologias provavelmente mudarão com o tempo”. Talvez o próximo passo para essas ferramentas de IA seja colocar barreiras à entrada para assumir o trabalho e dar um passo de volta à criatividade humana. Ok, talvez eu realmente queira dizer ‘espero’.