Você pode enganar a visão geral da IA do Google para explicar os idiomas formados

Quando grande tecnologia derramar Inúmeros dólares e recursos para a IAO evangelho de seu brilho inacreditável, é um lembrete de que os algoritmos podem danificar. Grande momento. Última evidência: você pode trapacear Visão geral do Google AI (Respostas automáticas no início de suas consultas de pesquisa) para explicar os idiomas fictícios e sem sentido como se fossem reais.

De acordo com a visão geral do Google (através de @EgregionR em bluesky), “Você não pode lamber um mezanino duas vezes” significa que você não pode trapacear ou enganar alguém uma segunda vez depois de ser enganado uma vez.

Parece um esforço razoável para explicar o idioma – se não for Poppycock. A derrota do Gemini Google aparece ao levantar a questão da pergunta que mencionou que uma frase foi estabelecida em vez do irracional Mumbo Jumbo projetado para enganá -la. Em outras palavras, Ai Ainda vivo e bom.

Conectamos um pouco de bobagem e encontramos o mesmo resultado.

A resposta do Google afirma que “você não pode jogar golfe sem peixe” é um quebra -cabeça ou tocando de acordo com as palavras, mostrando que você não pode jogar golfe sem o equipamento necessário, ou seja, uma bola de golfe. Curiosamente, a visão geral da IA acrescentou a disposição de que a bola de golfe “pode ser considerada” peixe “devido à sua forma”. Hum.

Depois disso, houve um ditado de longo prazo: “Você não pode abrir uma garrafa de manteiga de amendoim com a perna esquerda”. De acordo com a visão geral da IA, isso significa que você não pode fazer algo que exija habilidades ou habilidades. Novamente, a facada mais alta em uma tarefa atribuída sem fazer backup para verificar a existência real do conteúdo.

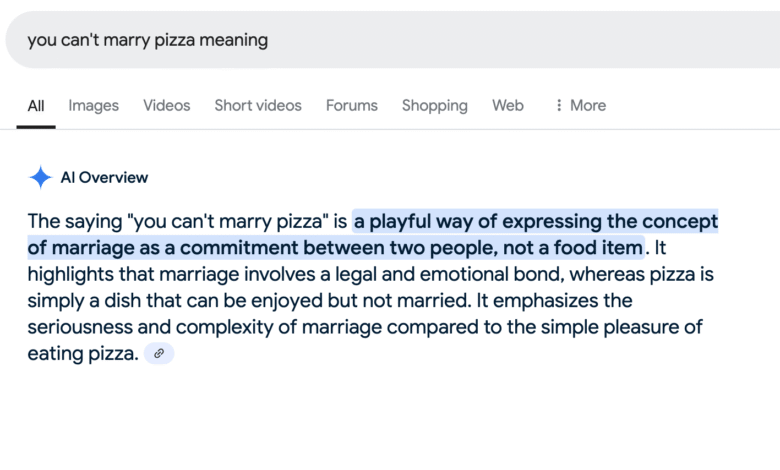

Existem mais. “Você não pode se casar com pizza” é uma maneira divertida de expressar o conceito de casamento como um compromisso entre duas pessoas, não um prato. . Requer a vontade de cooperar ou progredir naturalmente. . (Sábio Conselho.)

Este quase não é o primeiro exemplo de alucinações de IA, caso contrário, o usuário verificará o real, o que pode levar a informações falsas ou consequências reais. Basta perguntar Os advogados da igrejaSteven Schwartz e Peter Loduca Uma multa de US $ 5.000 em 2023 Usar o ChatGPT para estudar um resumo dos processos judiciais de clientes. A IA Chatbot criou casos que não existem, citados pelo advogado que o outro advogado (muito fácil de entender) não pode posicionar.

A reação do casal à disciplina do juiz? “Cometemos um erro de boa fé sem acreditar que parte da tecnologia poderia criar casos a partir de todo o tecido”.

Este artigo apareceu inicialmente em Engadget em https://www.engadget.com/ai/you-can-trick-googles-ai-overview-into-into-inpling-Pad

Link da fonte